Il Face ID di Apple è un sistema molto affidabile e preciso. Noi lo stiamo testando da giorni e siamo piacevolmente sorpresi dalla sua facilità d’uso e dall’immediatezza dello sblocco tramite riconoscimento facciale. Ma, nel dettaglio, come viene mappata la nostra faccia e in che modo il Face ID ci guarda? Scopriamolo di seguito.

Il Face ID sfrutta un sistema molto complesso di mappatura del volto in modo da analizzare attentamente ogni tratto e ogni particolare. Apple ha ampiamente spiegato come funziona questo sistema e come viene eseguita l’analisi del volto, anche mostrando le Animoji.

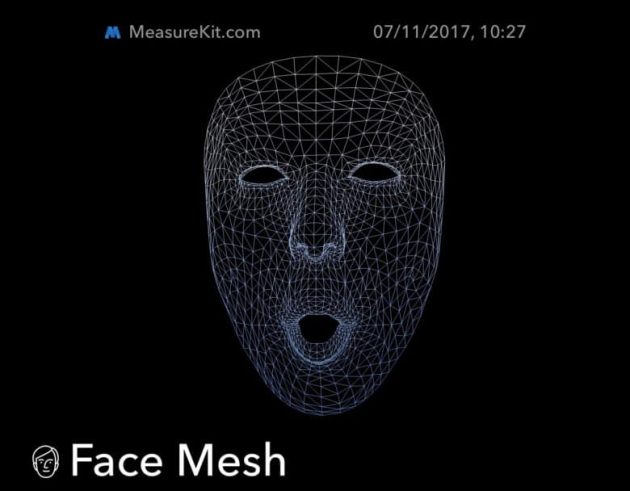

Oggi però vogliamo segnalarvi la presenza di un tool interessantissimo chiamato Face Mesh, disponibile all’interno di MeasureKit, un’app che sfrutta ARKit di Apple per eseguire misurazioni nel mondo reale.

L’ultimo update dell’applicazione sfrutta la nuova fotocamera frontale di iPhone X e tutti i sensori dedicati al Face ID per mappare il nostro volto e mostrarci quindi quello che vede il Face ID quando ci guarda per analizzare il nostro viso e sbloccare il nostro iPhone. Il bello è che si tratta di un framework di Apple quindi ciò che vedremo sarà coerente con il reale comportamento del sistema di riconoscimento del volto di Apple.

Lo sviluppatore di MeasureKit infatti specifica che l’app usa il framework SceneKit per rappresentare il nostro volto graficamente ma che ogni dato relativo alla mappatura del volto arriva direttamente da ARKit di Apple.

Face Mesh tool coming to MeasureKit later this week — measure face attributes while having lots of fun with your new #iPhoneX #ARKit 🦊 pic.twitter.com/TwHMFlxbOR

— MeasureKit (@MeasureKit) November 2, 2017

Potete provarci tutti quindi, basta scaricare l’applicazione ed eseguire la misurazione con Face Mesh. L’app è disponibile a quest’indirizzo.

Prova la nuova sezione commenti!